Wald 的统计判决理论通过把统计问题转换成数学最优化问题的解, 引入了各种优良性准则; 它引入了"行动"的概念, 并承担后果(损失函数), 使得数理统计可以以更大的经济利益等为发展目标.

1 三要素

对于某一个决策问题, 首先要得到观测数据 , 它有概率分布 , . 一旦知道了 , 就应该采取明确的决定. 这样, 第一个要素就是样本和概率分布族 .

其次, 需要明确决定有哪些. 例如如果最大生产能力为 , 则决定为 . 这里 是一个行动, 是行动空间, 记为 . 再或者做与不做, . 行动空间就是第二个要素.

最后需要明确行动的后果, 例如损失的钱数, 记为 . 损失函数是第三个要素.

某商店每天进货 件商品, 抽取 件检验, 为其中的废品数, 用来决定是否接受这批商品. 如果接受 (行动 ), 则每件废品损失 元; 若拒绝 (), 则当日无货出售, 每件损失利润 元.

可以认为 , , . 设废品率 , 则该批商品有废品 , 从而损失函数为

在这里我们没有纳入 的 先验分布, 因此统计判决问题也可以是频率学派的研究内容. 加入 先验分布的情况会在 Bayes 判决问题中介绍.

2 判决函数 风险函数

给定 , , , . 现在要根据样本值 确定行动 . 也即我们需要一个函数 , 把它称为判决/决策函数.

在刚刚的 例子 里, 判决函数可以是

此时的损失函数为 . 平均损失为 称为 的风险函数.

对上面的 例子, 风险函数为

根据 Wald 的理论, 判决函数的评估方法就是风险函数. 如果存在一个判决函数 , 使得任何 , 都有 则 称为判决问题的一致最优解.

3 统计推断与统计判决

统计推断的目的是追求真理: 比如弄清参数究竟是不是 . 它只管对错, 不论后果. 而统计判决考虑后果, 会考虑行动 的损失大小. 例如多生产零件会积压库存, 少生产零件只是营收减少, 此时无偏估计反而会产生偏差.

不过统计推断方法仍然可以用统计判决理论来解释, 例如

- 无偏估计中我们希望方差越小越好, 其实就是平方损失函数.

- 假设检验, 之前说的控制 来最大化 , 在判决语言中就是 损失.

- 区间估计: 把 不在区间里看作 损失 (, 准确性损失), 把区间长度 也看作损失(, 精确度损失). 控制 下最小化 .

4 Bayes 准则

在 Bayes 的观点下, 有先验分布 . 因此可以对 再求一次平均: 这里 称为 在 之下的Bayes 风险.

如果判决函数 使得 , , 则 称为一个 Bayes 解/Bayes 判别函数.

称 为 在得到 后的后验风险.

下面的定理告诉我们 Bayes 判决函数的找法.

, 如果 使后验风险达到最小, 即 , 则 () 是一个 Bayes 判决函数.

考虑任意判决函数 . 根据定义, Bayes 风险为 . 把它分成两步计算. 第一步是条件期望 第二步是对 求期望. 记 的边缘分布为 , 则 根据条件, , 有 于是

损失函数为平方损失:

,

Bayes 判决函数就是期望.

记 为 的均值、方差, 则 因此 Bayes 判决函数为 , Bayes 风险为

,

. 考虑

. 定义损失函数

,

, 这里

接受

,

拒绝

. 先验分布

,

.

则得到样本 后, 后验分布为 于是行动的后验风险分别为

根据 后验风险最小原则, Bayes 解为 这个解和 NP基本引理 提供的 UMP 检验符合, 不同的是 NP 中临界值由 确定, 而这里则取决于 . 的取值正好对应了 的作用, 差异反映了两类错误后果的不同.

如果所有 都有 , 则任何 都是 Bayes 判决函数, 但此时后验风险最小的解仍然可能唯一, 把它称为推广意义下的 Bayes 判决函数.

, 平方损失, 先验分布为

.

根据 这个结果, 的"后验分布"为 . 从而 Bayes 解为均值 . 它的风险函数为 , 从而 Bayes 风险为 从而 , .

在这个例子里, Bayes 准则没有意义, 但确实能得到唯一解, 它也确实有优点.

5 Minimax 准则

考虑 下的可能最大风险 让最坏情况尽可能小的准则被称为 Minimax 准则 (或者极小化极大准则).

是一个统计判决问题的 Minimax 解/判决函数, 如果 : .

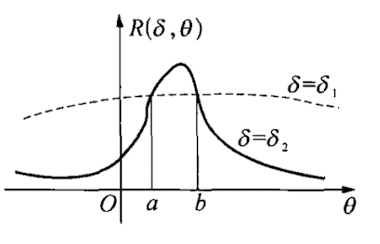

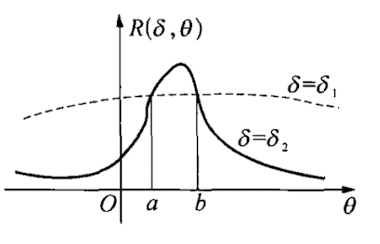

从这张图看出, Minimax 是一个保守的估计. , 所以 在 Minimax 意义下是个更好的估计. 不过如果大多数情况下 不在 上, 总是更好. 所以 Minimax 只作为先验估计不足时候对保险选择.

Minimax 也不是很好求. 目前得到的 Minimax 解主要通过下面两个定理求得, 它们的主要作用是验证某个解是 Minimax 解.

设 为某个先验分布 的 Bayes 解, 且 的风险函数 . 则 是一个 Minimax 解.

如果 不是的话, , 则 这和 为 Bayes 解相矛盾.

设

, 估计

, 平方损失, 求

的 Minimax 估计.

取 的 共轭先验分布 . 当 , 后验分布为 . 根据 这个例子, Bayes 估计就是 Beta 分布的期望值 , 风险函数为 考虑到 , 故 若取 , 则上式右边为 . 于是根据 定理5.1, 是 的 Minimax 估计.

从这个定理我们看出:

- Minimax 与先验无关, 频率学派也能接受. 但有时这个解确却是某些先验分布下的 Bayes 解.

- 这里引进的 可以认为只是解题工具, 所以频率学派也能接受.

- 传统估计 的风险函数为 . 虽然 不是 Minimax 解, 但是对于多数 , , 因此实际上还是 用得多. 事实上 对应的先验分布 , 会在 两侧迅速衰减.

前面的定理要求风险函数为常数, 这实际上很难满足. 下面的定理适用范围更广.

设一个统计判决问题在先验分布 下的解为 , Bayes 风险为 . 设 , 又有判决函数 , 则 为判决问题的 Minimax 解.

反设 不是 Minimax 解, 则 . 则根据定理 5.2 的条件, 当 充分大, . 于是 的 Bayes 风险 满足 这和 是 下的 Bayes 解矛盾.

找一串先验分布 , , . 根据 这个例子, Bayes 解是后验分布的均值. 根据 这个例子, . 其风险函数为 在 下对上式右边求期望, 得到 的 Bayes 风险为 显然 . 取 , 则 . 根据 定理5.2, 是 的 Minimax 估计.

6 同变原理

前面的 Bayes/Minimax 都是制定了一个指标 或 . 另一种方法是首先对判决函数提出一个要求, 在满足要求的类 里寻找一致最优解. 例如无偏性. 这里介绍另一种: 同变性要求.

考虑估计某个物体的重量 . 称重 次得到 , 估计 . 设 . 若把坐标原点移到 , 则物体重量变为 , , 则估计值为 , 还原为 的估计为 从而我们要求 这就是对变换 提出的同变性要求. 这样的估计量称为同变估计量. 其中风险一致最小的称为最优同变估计. 又或者伸缩 (如改变单位):

一个统计判决问题要运用同变性, 需要满足以下两个要求:

- 能定义 的双射, 它们构成一个群. 且这个群内每一个变换都能把样本分布变换到当前分布族内.

- 每当变换 引起 , 在行动空间都能找到一一映射 , 使 .

此时如果 , 则 称为同变的.

下面举一个同变性的应用: 若取平方损失, 则 是 的最优同变估计.

设 , 满足条件 , . 则 与 独立.

作正交变换 , 的第一行为 , 且 , . 根据 引理3.1, 独立, 只和 有关.

设 . 当 , 变换为

于是由 , 有 这说明 其实和 无关, 即有 的形式. 故 考虑到 相互独立, .

现在回到问题. 取 任一同变估计 , 记 . 由同变条件: 所以根据引理, . 又 因为 , 所以 所以 是 一切同变估计中风险一致最小者.

7 容许性

这是关于最优性的一个条件, 任何优良判决函数都理应拥有.

对判决函数 , 如果存在另一个 , 使

- , .

- , .

则称 一致地优于, 称为不可容许的. 反之, 如果不存在一致优于 的 , 则 是可容许的.

判决函数的容许性取决于样本分布族、损失函数、参数空间等各个要素. 例如 , 平方损失, 用 估计 . 如果 , 下面证明它是容许的; 而如果 , 则定义 则 一致优于 .

容许性的问题在于, 给定判决问题, 很难确定哪些判决函数可容许/不可容许. 以下的定理可以解决一部分情况:

设 是某个先验分布下的 Bayes 解. 设 . 满足条件:

- , 风险函数 关于 连续;

- , , ;

- 的 Bayes 风险 .

则 是可容许的.

否则 : , , 且 , 使 . 因为 , 关于 连续, 故 , , 有 . 此时 这里 , . 因为 上 , 上 , 从而 这与 是 下的 Bayes 解矛盾.

-

考虑 这个例子. 在 上有处处大于 的密度, 故条件 2 满足; 条件 3 显然满足; 对条件 1, 注意到任一 的风险函数: 关于 连续. 因此根据 定理7.1, Minimax 估计是可容许的.

-

设 . 平方损失. 为常数, 则 是 的可容许估计. 事实上取 , 选择 : . 则由 这个例子 和 这个结论, 是这个先验分布下的 Bayes 解. 不难验证定理 7.1 的 1~3 都满足, 因此 是容许估计. 其中 3: 需要验证它处处有限且可在积分下对 求导.

令 就有 , 因此 是容许估计的极限, 但它并不一定就容许. 下面的方法基于 C-R 不等式, 可以处理有关单参数指数族的参数在平方损失下的某些容许估计问题.

设 为 任意估计, 满足: 记 , 存在. 根据 C-R不等式, 由此 , 其中 . 则 . 由上式 , 故 单减. 现在证 : 否则 . 根据单调性, . 从而由 , 当 , 有 令 , 则 , 这和 、 单减矛盾, 从而 .

这样有两种情况:

- . 此时 为 的无偏估计, 而 为 的 UMVUE, 故 此时 不一致优于 .

- 存在 : . 此时 : . 但 时, . 否则 (*) 不对一切 成立. 故 , . 因此在 (**) 中令 , 有

因此只有情况 1 成立. 而一致优于 的 不存在, 这就证明了 的可容许性.

现设 个总体, 有分布 . 从第 个总体中抽样 , 合样本全部独立. 估计 . 损失函数为: 一个自然的估计量是 , 其中 . 对于 可以证明它是容许的, 但 时上述估计非容许. 这启示我们, 容许性是一个很复杂的东西.